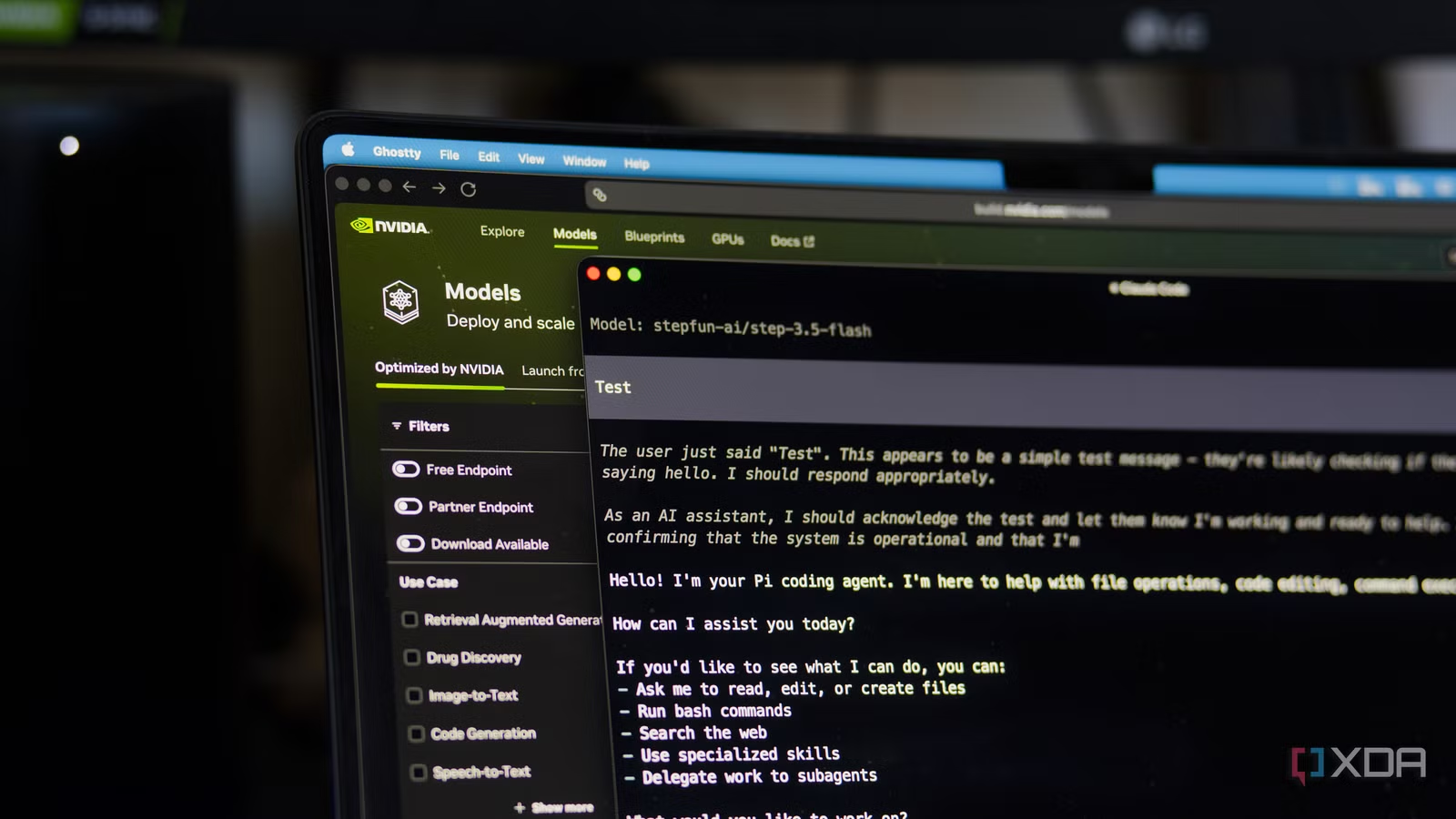

J’ai exécuté gratuitement certains des plus gros LLM ouverts sur le cloud de Nvidia.

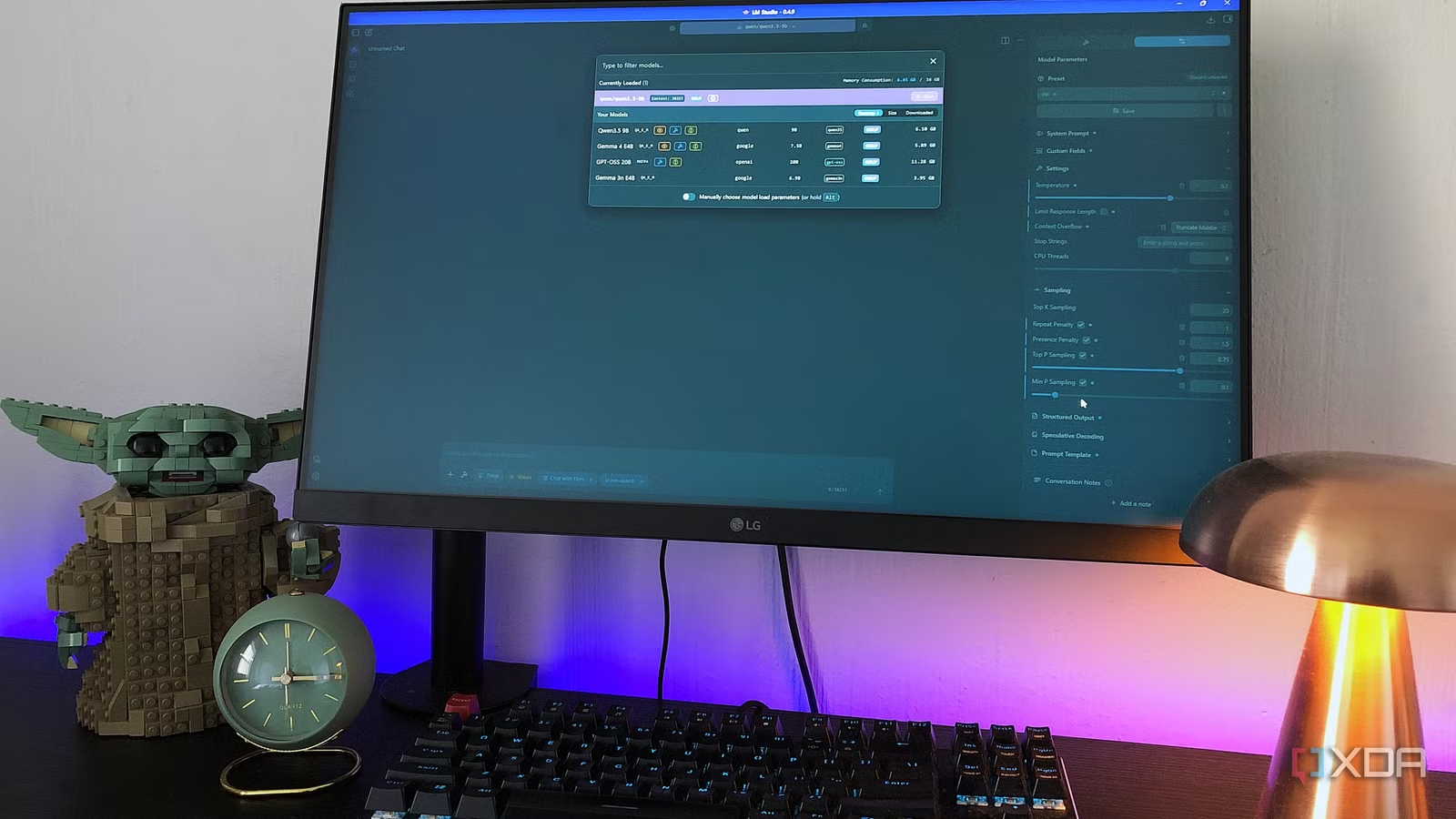

Si vous avez passé du temps dans l’espace LLM local, vous connaissez certainement le plafond matériel. Les modèles open source les plus intéressants ne cessent de s’élargir, et l’écart entre ce qui est publié sur Hugging Face et ce que vous pouvez réellement charger dans la VRAM à la maison s’est généralement creusé, sans la … Read more