Si vous avez passé du temps dans l’espace LLM local, vous connaissez certainement le plafond matériel. Les modèles open source les plus intéressants ne cessent de s’élargir, et l’écart entre ce qui est publié sur Hugging Face et ce que vous pouvez réellement charger dans la VRAM à la maison s’est généralement creusé, sans la poignée de versions par an qui fonctionnent sur n’importe quoi et sont véritablement impressionnantes. Bien sûr, vous pouvez télécharger gratuitement un modèle mélange d’experts 230B, mais ce n’est pas gratuit. courir. Vous avez besoin d’un poste de travail qui coûte autant qu’une voiture, et même dans ce cas, vous quantifiez souvent la chose dans l’oubli juste pour l’adapter.

C’est pourquoi j’ai essayé les points de terminaison hébergés par Nvidia sur le site Build Nvidia. Ce n’est pas une nouvelle plate-forme, mais la gamme de modèles s’est progressivement développée pour devenir quelque chose que beaucoup de gens ont manqué, je pense. Vous vous inscrivez au programme de développement, générez une clé API et obtenez un accès gratuit à des dizaines des plus grands modèles open source, servis à partir du matériel DGX Cloud de Nvidia. Tous les modèles du catalogue ne sont pas disponibles au niveau gratuit, et quelques-uns sont signalés pour une dépréciation prochaine, mais la variété de modèles gratuits est suffisamment large pour couvrir la plupart de ce que vous voudriez réellement essayer. Vous n’avez pas besoin de soumettre une carte de crédit, il n’y a pas de facturation par jeton et, plus important encore, vous n’avez pas à payer vous-même de frais GPU.

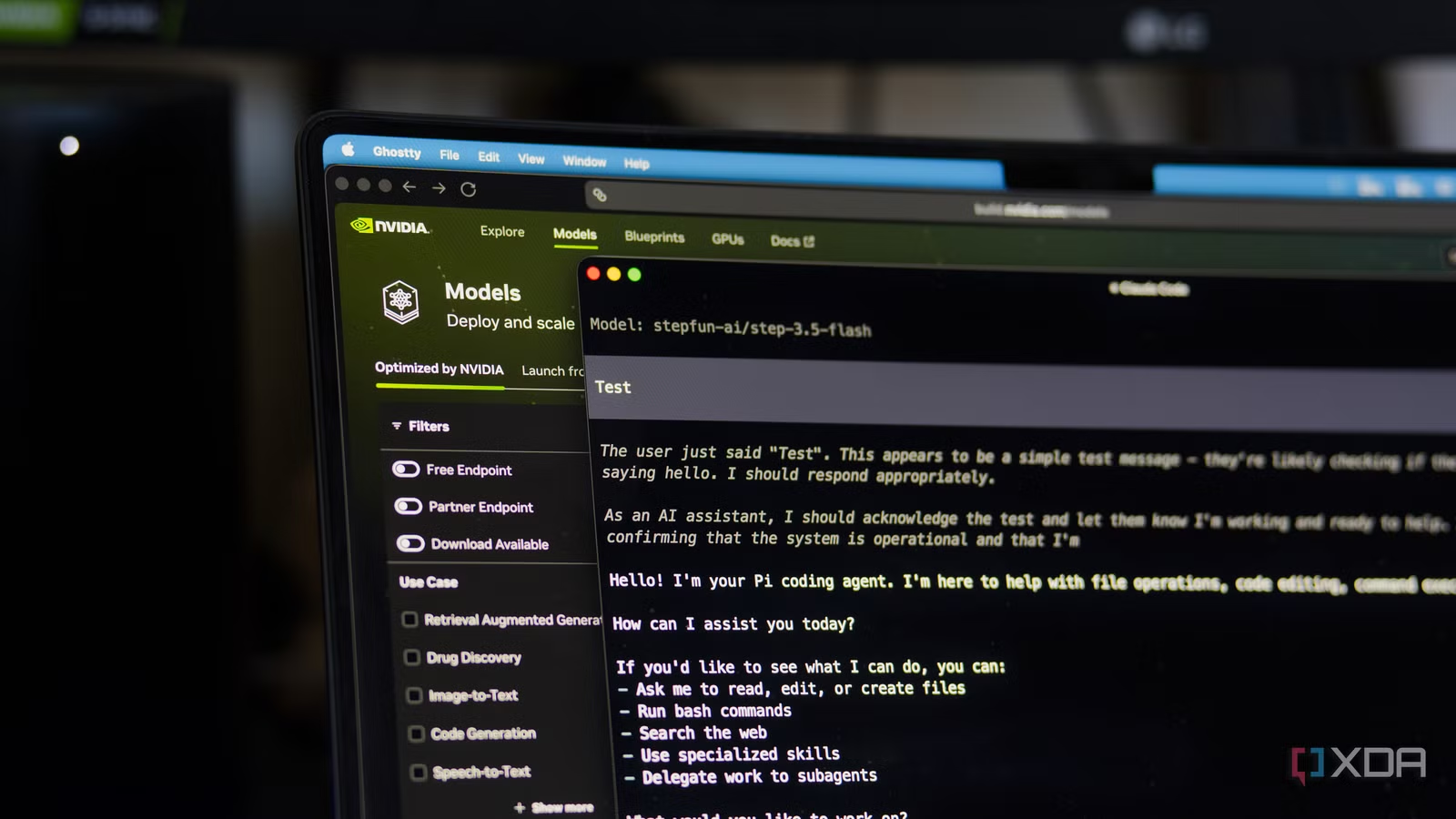

Il y a probablement des limites de débit quelque part, et vous devez faire confiance à Nvidia pour la demande, mais ça marche. Je l’utilise via mon propre harnais de codage depuis des semaines maintenant pour tester des modèles que la plupart des gens ne peuvent jamais exécuter à la maison, et c’est étonnamment bon.

La programmation est bien plus grande que ce que les gens lui attribuent

La plupart des modèles que je souhaite essayer sont déjà là

Le catalogue compte actuellement plus d’une centaine de modèles, dont 50 (au moment de la rédaction) portent la balise « Free Endpoint », mais le nombre n’a pas autant d’importance que la curation. Par exemple, le MiniMax M2.7 est là, que j’ai d’ailleurs testé par le passé avec un abonnement MiniMax étant donné qu’il s’agit de l’un des concurrents open-weight les plus crédibles de Claude. Il en va de même pour Step-3.5 Flash, le modèle Stepfun que j’ai adoré sur la Lenovo ThinkStation PGX. La propre famille Nemotron de Nvidia est également présente, un ensemble de modèles ouverts de raisonnement et axés sur les agents que Nvidia a affiné comme une vitrine de ce que sa propre pile de formation peut faire.

Comme pour certains autres modèles, le GLM-4.7 est arrivé récemment, bien qu’il soit loin d’être aussi puissant pour le codage que le GLM-5.1. Kimi K2 Thinking, Qwen3-Coder-480B, DeepSeek V3.2, Llama 4 Maverick, Mistral Large 3, Devstral 2, Seed-OSS de ByteDance et la famille Gemma 3 de Google sont également présents, il existe donc une grande variété en termes de ce que vous pouvez essayer. Une poignée d’anciennes entrées Mistral et DeepSeek comportent des avis de dépréciation, la gamme n’est donc pas statique, mais les nouveaux points de terminaison gratuits ont atterri plus rapidement que les anciens.

Le meilleur, c’est que tous ces modèles sont massifs. MiniMax M2.7 est un MoE clairsemé de 230 milliards de paramètres avec 10B actifs par jeton, et Step-3.5 Flash est un modèle 196B avec 11B actifs et une fenêtre contextuelle de 256K. Ce sont en fait des modèles utilisables qui peuvent alimenter un travail réel, mais c’est aussi le genre de modèles qui nécessitent un serveur sérieux pour être hébergés. Il existe certaines limitations par rapport à son exécution locale, la plus notable étant qu’il ne s’agit que de points de terminaison d’inférence, vous ne pouvez donc pas affiner ou modifier un modèle. Ce que Nvidia héberge est ce que vous obtenez, mais pour le type de travail de test et d’évaluation que les gens pourraient vouloir faire, c’est plus que suffisant.

Ces modèles sont toujours des modèles ouverts, et vous pouvez toujours les extraire de Hugging Face, les exécuter sur votre propre matériel si vous l’avez et les affiner sous la licence avec laquelle ils sont livrés. L’hébergement de Nvidia n’est qu’une couche de commodité supplémentaire qui vous permet « d’essayer avant d’acheter » dans un sens. Contrairement à la sortie d’une nouvelle version GPT, c’est OpenAI qui héberge un modèle, et c’est le seul endroit où le modèle existe. Lorsque Nvidia héberge MiniMax M2.7, les poids sont publiés, l’architecture est documentée et la seule chose que vous payez réellement, si vous décidez finalement de l’auto-héberger, est la puissance GPU nécessaire pour l’exécuter. Il n’existe aucune version de cette offre particulière dans laquelle le niveau gratuit vous enferme.

L’installation est essentiellement un point de terminaison compatible OpenAI

Si votre outil parle OpenAI, il parle Nvidia

Le tout est construit autour d’une API compatible OpenAI, ce qui facilite grandement l’intégration dans les outils existants. Vous vous inscrivez sur build.nvidia.com avec le compte gratuit Nvidia Developer, vous générez une clé API préfixée par “nvapi-“, et c’est tout. L’URL de base est “https://integrate.api.nvidia.com/v1” et le reste des appels ressemble exactement à ce que vous enverriez à n’importe quel service compatible OpenAI.

En pratique, cela signifie configurer quelque chose comme ceci dans votre faisceau de codage :

"nvidia-build": {

"baseUrl": "https://integrate.api.nvidia.com/v1",

"api": "openai-completions",

"apiKey": "nvapi-XXXXXXXXXXX",

"models": (

{

"id": "stepfun-ai/step-3.5-flash",

"contextWindow": 200000

},

{

"id": "minimaxai/minimax-m2.7",

"contextWindow": 200000

}

)

}Après cela, si vous souhaitez changer de modèle, il vous suffit de modifier l’identifiant ou le nom du modèle pour qu’il corresponde à celui qui figure sur la page du catalogue. L’appel d’outils a fonctionné proprement dans tout ce que j’ai lancé jusqu’à présent, y compris les éléments agents comme MiniMax M2.7 et Step-3.5 Flash.

J’exécute ces modèles via Pi, mais tout autre harnais de codage capable d’utiliser les complétions de style OpenAI, tel qu’OpenCode, fonctionnera également. Il s’agit du même exploit que celui que j’ai indiqué sur la propre API de MiniMax, GLM-5.1, et sur certains de mes modèles auto-hébergés. L’échange dans le point de terminaison de Nvidia est un changement d’URL de base et une clé API, rien de plus. Si vous utilisez déjà quelque chose comme Aider, Continue ou tout autre outil vous permettant de spécifier un backend personnalisé compatible OpenAI, la configuration prend environ une minute.

Il existe, en théorie, une limite de débit avec laquelle vous devez vivre sur le niveau gratuit, mais je n’en ai pas encore rencontré au cours des semaines d’utilisation régulière, et Nvidia n’en publie pas. Pour le travail de codage interactif ou les évaluations ponctuelles, quel que soit le plafond existant, je n’ai pas été confronté à cela. Vous n’allez pas l’utiliser pour servir une application de production car cela peut être assez lent (surtout aux heures de pointe), et c’est très bien. Ce n’est pas pour ça.

Le niveau gratuit de Nvidia fonctionnait auparavant sur un système de crédit, dans lequel vous obteniez une allocation lors de votre inscription et pouviez en demander davantage si vous en aviez besoin, et ce système a tranquillement évolué au cours de l’année écoulée. L’état actuel, en avril dernier, est plus ou moins un plan gratuit pour toujours avec des limites de taux comme principale contrainte, plutôt que des crédits par jeton. Il existe toujours un pool de crédits lié au programme de développement pour certains des modèles les plus grands ou les plus spécialisés, mais pour les gros titres à poids ouvert, le débit est la seule chose à laquelle vous êtes vraiment confronté. Je comprends pourquoi Nvidia le gère de cette façon, car ils vendent les GPU sur lesquels ces modèles fonctionnent, et cela sert vraiment de vitrine ou d’entonnoir de vente. Il se trouve que cela s’avère également utile à tous ceux qui souhaitent simplement essayer un modèle nettement plus grand que ce que leur matériel permet.

Il existe bien sûr d’autres endroits qui vous donneront accès aux mêmes modèles, et ils n’auront pas les mêmes problèmes de débit. OpenRouter regroupe un grand nombre de ces mêmes modèles ouverts derrière un seul compte de facturation, Groq exécute un ensemble plus petit sur son propre silicium LPU à des vitesses que la plupart des piles GPU ont du mal à égaler, et Together AI exécute une API de modèle ouvert depuis des années. Ce que Nvidia a, contrairement aux autres, c’est la combinaison d’une correspondance matérielle évidente avec la façon dont ces modèles sont déployés en production, d’un niveau gratuit suffisamment généreux pour être utile et d’un catalogue organisé qui a tendance à récupérer les nouvelles versions à proximité du jour de leur sortie. Aucun de ces éléments à lui seul n’en fait le choix évident, mais ensemble, ils le rendent extrêmement attrayant.

Les points de terminaison hébergés ne remplacent pas le local, ils étendent ce que vous pouvez tester

Exécuter 196B à la maison n’est toujours pas une solution pour la plupart des gens

Je dirige quotidiennement des LLM locaux et j’ai été assez ouvert sur le fait que pour le type de travail que je fais réellement, les modèles plus petits conviennent généralement. Qwen3-Coder-Next sur mon propre matériel est toujours mon choix pour tout ce qui concerne la confidentialité ou lorsque je ne veux pas de dépendance au réseau dans la boucle. Le local gagne toujours lorsque le local est suffisant.

Mais le problème est que le local n’est pas toujours suffisant, et l’écart apparaît exactement aux tailles de modèles hébergés par Nvidia. Il n’existe aucun moyen réaliste pour moi d’exécuter MiniMax M2.7 sur la ThinkStation PGX. Le modèle complet nécessite un matériel sérieux, et l’utilisation de la quantification 3 bits pour l’exécuter sur cette machine enlève suffisamment de son intelligence pour que je ne teste plus réellement le même modèle. Si je veux savoir comment M2.7 s’acquitte réellement d’une tâche qui me tient à cœur, j’ai besoin qu’il soit exécuté avec une précision totale. Le point de terminaison de Nvidia est le moyen le plus simple d’obtenir cela sans payer directement MiniMax ni configurer un cluster H100.

C’est le moyen le plus pratique d’utiliser l’API gratuite, car c’est un moyen d’évaluer honnêtement les plus grands modèles à poids ouvert, par rapport aux mêmes invites et tâches que celles que j’exécute sur ma pile locale, sans avoir à prétendre que le modèle fortement quantifié est le vrai. Je l’ai utilisé pour jouer avec Step-3.5 Flash sans avoir à me soucier d’une erreur de mémoire insuffisante, et j’ai joué avec d’autres modèles que je n’aurais normalement pas pris la peine de configurer localement. De plus, j’ai découvert la plateforme gratuite de Nvidia après avoir commencé à tester MiniMax, mais je l’aurais d’abord testé sur l’API de Nvidia avant de me lancer dans l’abonnement mensuel de base.

Il y a un groupe de personnes pour lequel cela est particulièrement utile, et ce sont les personnes qui évaluent un Nvidia DGX Spark, une station de travail à haute VRAM ou un Mac Studio pour le travail d’IA local. Si vous êtes sur le point de dépenser quelques milliers de dollars pour un boîtier dans le but exprès d’exécuter ces modèles, le faire sans essayer au préalable les modèles réels sur les points de terminaison gratuits de Nvidia est une erreur. Vous pouvez passer un week-end à exécuter Step-3.5 Flash, MiniMax M2.7 et quelques variantes de Nemotron via vos propres flux de travail réels, voir lesquels correspondent réellement à votre façon de travailler, puis dimensionner votre matériel en fonction de cette réponse. C’est une décision d’achat que vous ne pouvez pas annuler à moindre coût, mais la tester est totalement gratuite.

Le seul inconvénient est que rien ici n’est privé. Vous envoyez vos invites à l’infrastructure de Nvidia, l’utilisation est enregistrée et les modèles ont chacun leurs propres politiques de données. Pour les travaux d’évaluation et d’exploration, c’est tout à fait correct, mais pour tout ce qui touche des données réelles ou tout ce que vous considérez comme sensible, ce n’est pas le bon outil.

L’accès gratuit aux poids ouverts à l’échelle frontière est une affaire plus importante qu’il n’y paraît

Plus que suffisant pour répondre à ce dont la plupart des gens ont réellement besoin

Les dernières années de l’IA locale ont été en grande partie une histoire de compression intelligente sans réduire la qualité de sortie et de recherche de moyens d’exécuter des versions de plus en plus petites de modèles de plus en plus grands. Cependant, les nouvelles architectures et les capacités de ces modèles qui peuvent vraiment vous surprendre sont celles qui arrivent à une échelle qui ne convient pas au matériel domestique.

Un point de terminaison gratuit et compatible OpenAI servant les pondérations de pleine précision de ces modèles ouverts, hébergé par la société qui fabrique les GPU sur lesquels ils fonctionnent, va à l’encontre du statu quo des modèles fermés. Vous pouvez essayer les grandes choses, tout en les comparant à ce que vous pouvez déjà exécuter localement. Et lorsque vous avez terminé vos tests, vous pouvez passer un appel éclairé pour savoir quel modèle vaut votre budget matériel ou vaut la peine d’être payé sur OpenRouter avant de dépenser quoi que ce soit.